Fala galera do mundo dos dados! Seguimos na missão do projeto de análise de dados com Airbyte e Metabase. Agora é hora de criar o pipeline de dados Airbyte com GA4 e Snowflake! Já configuramos um primeiro pipeline de dados Airbyte com PostgreSQL, agora criaremos outro, com outro destino de dados.

Neste pipeline faremos o fluxo de dados com origem no Google Analytics e destino em um banco de dados Snowflake. A ideia é extrair os dados do GA4, que será o substituto do Google Analytics Universal. Portanto, vamos as etapas necessárias.

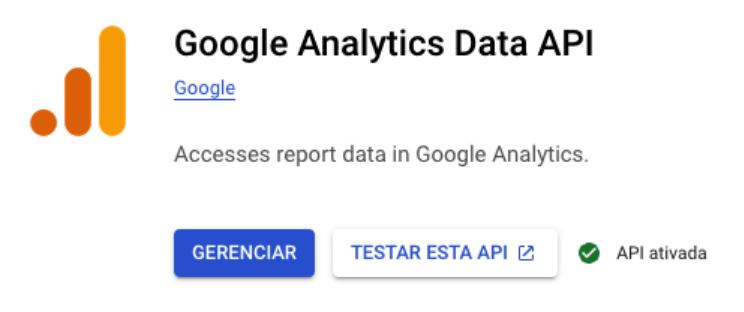

Liberar Acesso a API do GA4

Primeiramente será necessário a liberação de acesso a API do GA que é feita através do GCP (Google Cloud Platform). Na imagem abaixo a API que estamos liberando o acesso aos dados. Lembrando que não é a mesma API para consumo dos dados do Analytics Universal.

Agora já podemos configurar a origem dos dados no Airbyte.

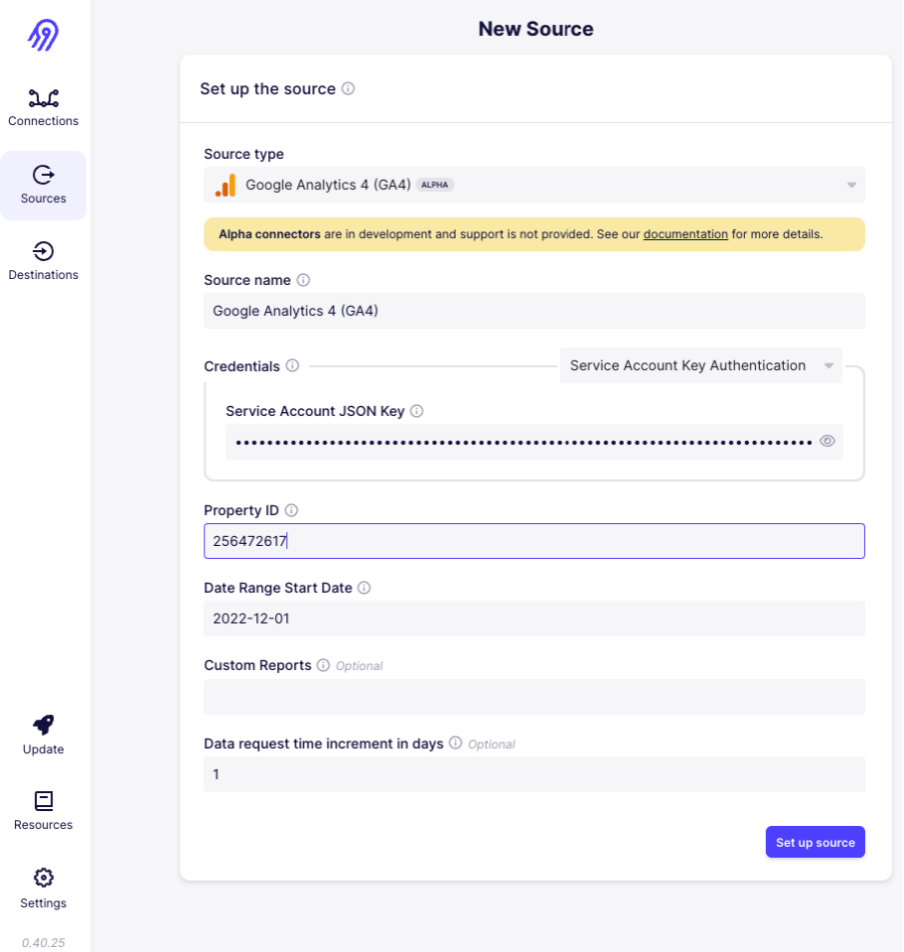

Configurar a Origem de Dados no Airbyte

Seguimos para a opção Sources, que é onde configuramos as origens de dados. Em seguida criaremos uma New Source do tipo GA4 conforme a imagem abaixo. E passamos a credencial de acesso, a data de início e o ID no GA.

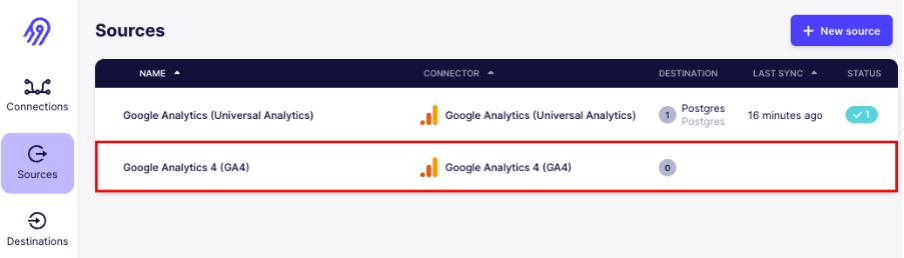

E então temos a origem de dados do GA4 configurada, como está sendo exibido na imagem abaixo. Além da origem configurada, podemos ver todas as outras configuradas anteriormente.

Origem configurada, a próxima etapa é realizar a configuração do destino.

Configurar o Destino de Dados no Airbyte

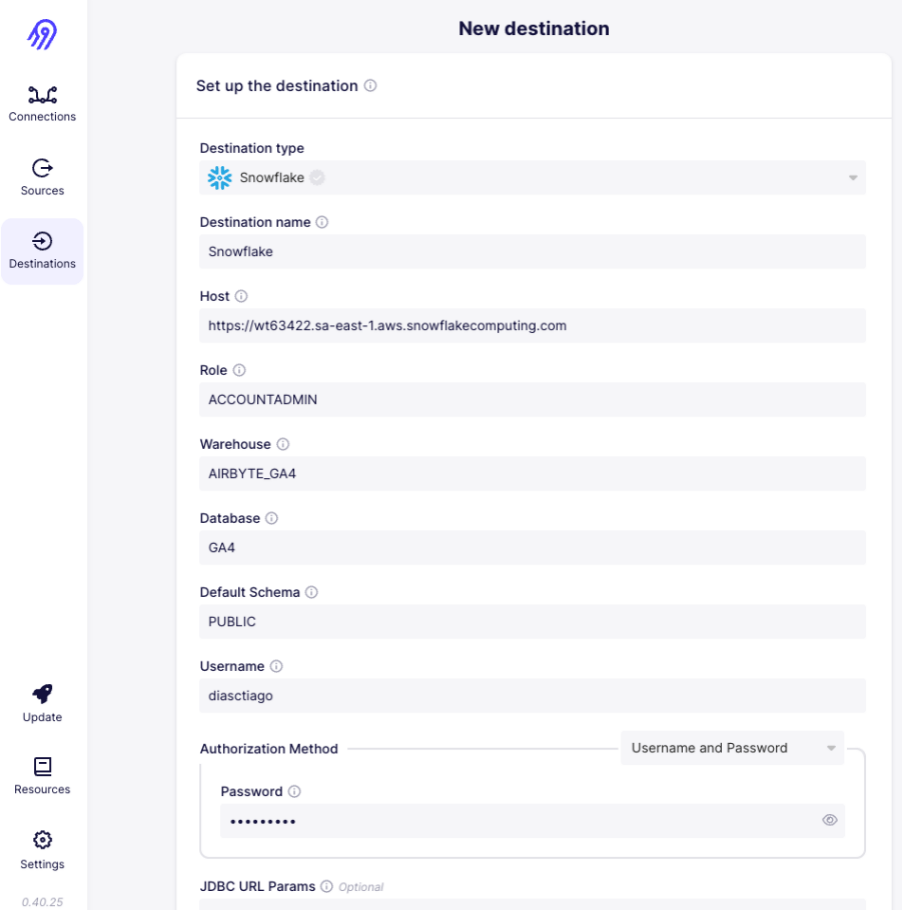

O destino dos dados, onde vamos persistir os mesmo, configuramos em Destinations, em seguida criamos uma New destination. Agora, selecionamos o tipo, neste pipeline será o Snowflake. Precisamos dos parâmetros de acesso ao banco: host, role, warehouse, esquema, usuário e senha. Conforme exemplo na imagem abaixo.

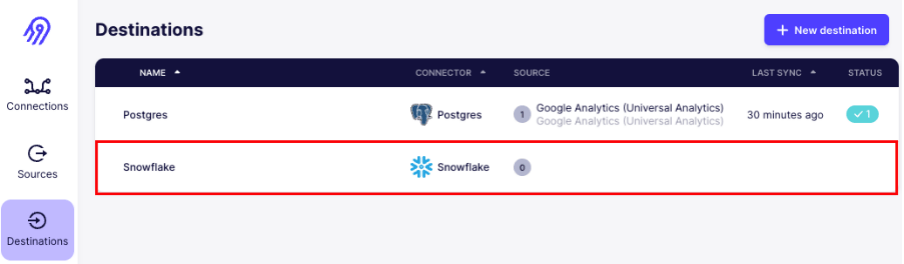

Logo, temos também o destino dos dados configurado! A imagem abaixo, lista os destinos de dados configurados.

Em seguida, só precisamos juntar as pontas, e ligar a origem ao destino necessário. O resto é por conta do Airbyte, que vai fazer TUDO para nós 🚀!

Criar a Conexão de Origem e Destino no Airbyte

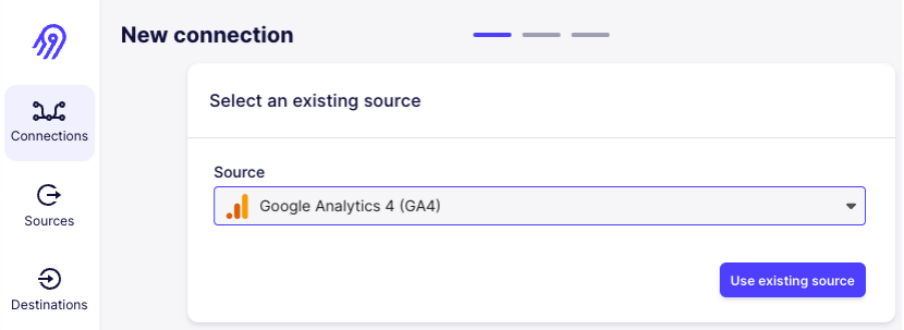

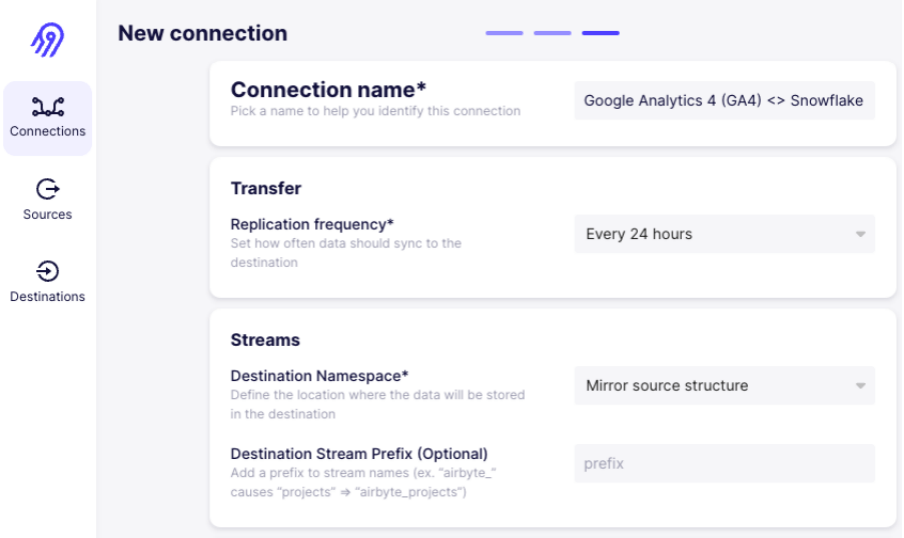

Chegou a hora das conexões, onde juntamos origem e destino dos dados. Para isso, temos a opção Connections, em seguida New connection. Você confere tudo isso na imagem abaixo, onde selecionamos a origem dos dados do GA4 que criamos anteriormente.

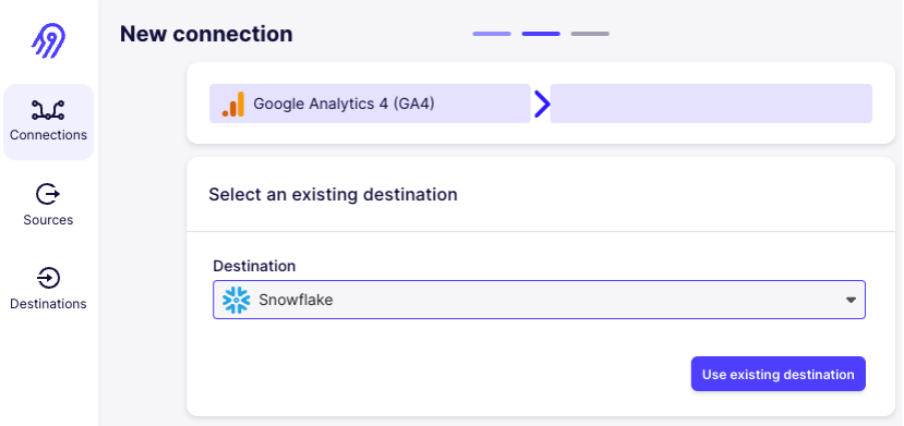

Origem selecionada, o próximo passo é escolher onde vamos armazenar os dados. Selecionaremos o destino Snowflake, também criado anteriormente.

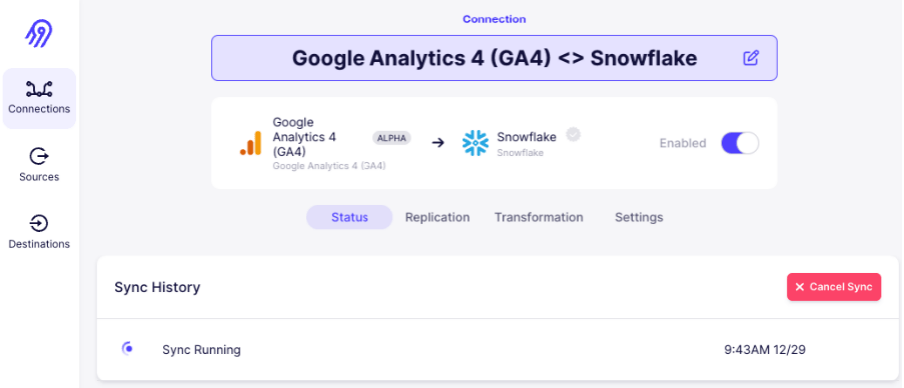

Para finalizar, faremos a sincronização dos dados. E então, a carga dos dados será realizada, levando da origem até o destino através do Airbyte.

Na imagem abaixo é possível ver a conexão configurada.

Após a carga finalizar, fazermos uma verificação em uma conexão direta com o banco utilizando a plataforma do Snowflake.

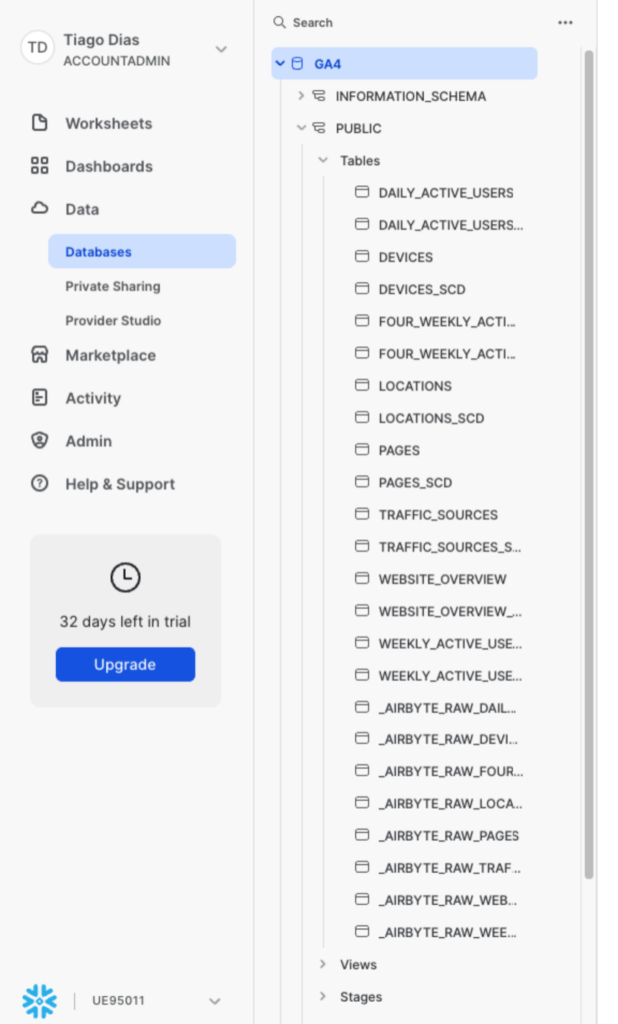

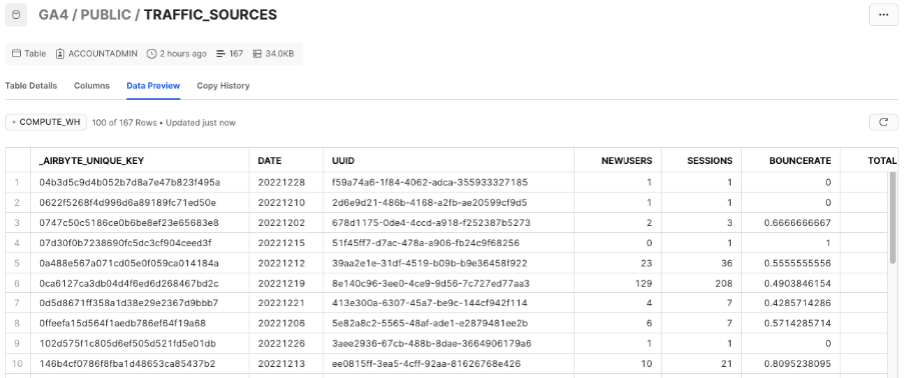

Visualizar a Carga de Dados no Snowflake

Para visualizar os dados da carga, acessar o banco GA4. É possível ver na imagem abaixo as duas camadas criadas pelo Airbyte na carga, uma raw com os dados brutos e uma outra com os dados tratados. Tudo feito pelo próprio Airbyte!

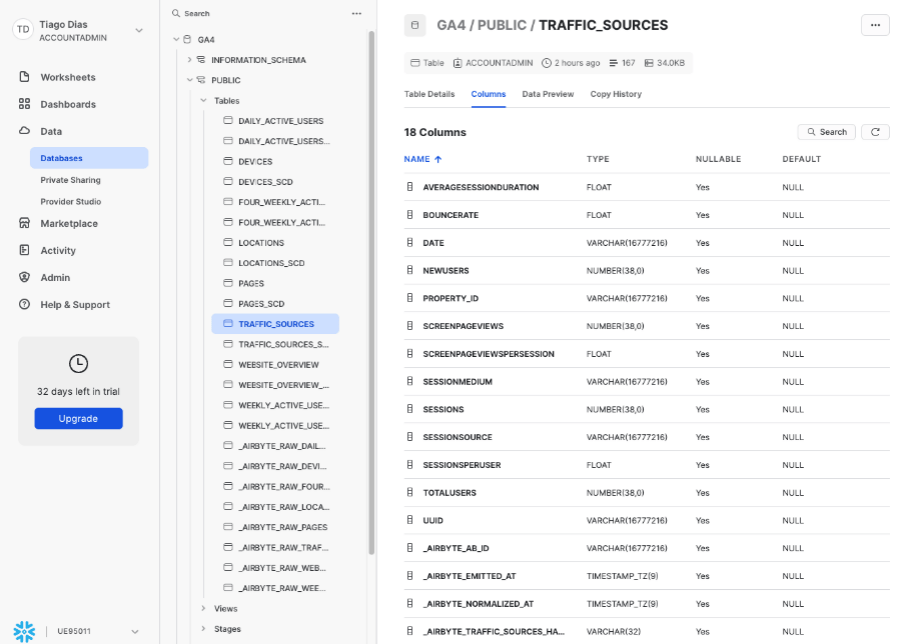

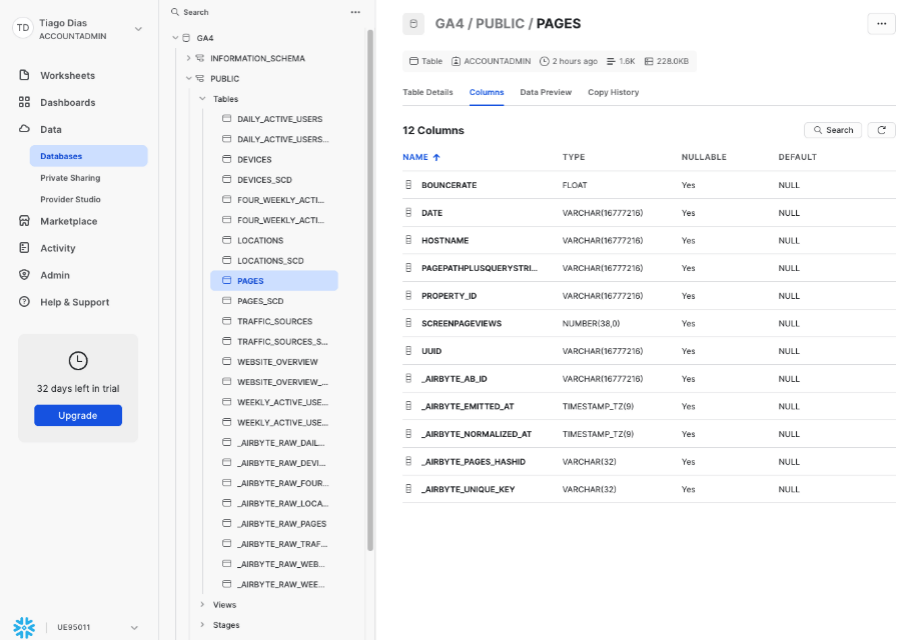

Selecionamos uma tabela para conferir as colunas e os tipos de dados, como podemos ver na imagem abaixo.

Em seguida, vamos dar um Data Preview nessa tabela para ver os registros das primeiras linhas.

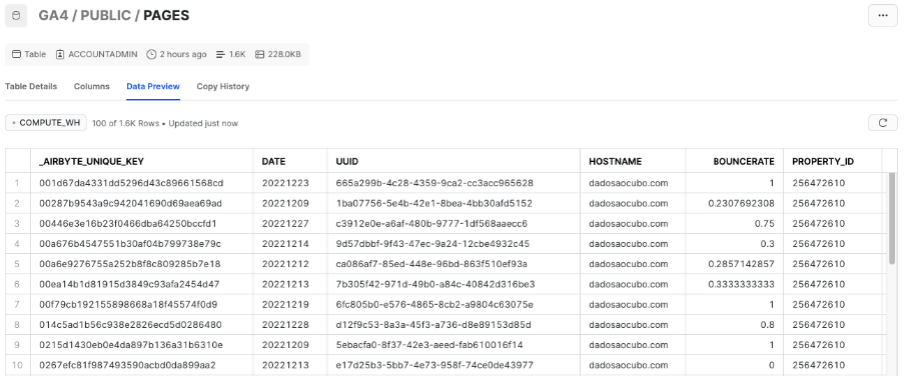

Mais uma tabela para conferir campos e tipos de dados.

Mais uma vez, uma verificação para fazer um check da carga dos dados.

E então a carga foi realizada com sucesso! Criação de um pipeline de dados Airbyte com GA4 e Snowflake de uma forma bem simples. E assim finalizamos mais um pipeline de dados com o Airbyte. Espero que goste do conteúdo e que ele seja útil. Um abraço e até a próxima!

Conteúdos ao Cubo

Se você curtiu o conteúdo, lá no Dados ao Cubo tem muito mais. Então, deixo algumas sugestões de conteúdos que você pode encontrar por lá, sempre falando sobre o mundo dos dados.

- Conectar Banco de Dados MySQL com Python

- Introdução à Gramática dos Gráficos com plotnine

- Métodos de Classificação para Classes Desbalanceadas

- Estatística Descritiva Univariada

- Geometria Analítica com SymPy

- Deploy de Modelos com Heroku

- Loops em Python

- Descubra Como Utilizar o DBSCAN em Python para Análise de Dados

Finalizo com um convite para você ser Parceiro de Publicação Dados ao Cubo, escrever o próximo artigo e ter divulgação para toda a comunidade de dados no LinkedIn.

Apaixonado por dados e tecnologia ❤️ , criando soluções com dados 📊 📈 , desde 2015, sempre buscando tornar os processos orientados! Com formação em Engenharia da Computação 💾 , MBA Gestão da Informação e Business Intelligence e Especialização em Data Science.

Também atuo como professor na área de dados. Nas horas vagas crio modelos de Machine Learning 🤖 com Python em desafios do Kaggle e escrevo no Dados ao Cubo sobre o mundo dos dados 🎲 !

Compartilhando conhecimentos sempre 🚀